Новости

Ведущие компании в области искусственного интеллекта начали активно привлекать актёров импровизации и театра для создания обучающих данных, необходимых для совершенствования моделей генерации и распознавания человеческих эмоций. Одним из ключевых подрядчиков выступает Handshake AI, предоставляющий данные, в частности, для OpenAI.

Согласно опубликованным вакансиям, актёрам предлагается участие в оплачиваемых онлайн-сессиях, где они совместно с другими исполнителями разыгрывают заданные сценарии и эмоциональные сцены. Цель — собрать примеры аутентичного выражения и переключения эмоций, а также передачи интонаций, которые сложно смоделировать с помощью традиционных текстовых корпусов.

Компании отмечают, что современные языковые модели, несмотря на успехи в ряде сложных задач, часто демонстрируют «непостоянный» уровень навыков: они могут справляться с техническими вопросами, но ошибаются в простых бытовых или эмоциональных ситуациях. Для устранения этих пробелов требуется специализированная разметка и новые типы данных.

Handshake AI и её конкуренты, такие как Mercor и Scale AI, расширяют сеть подрядчиков, включая специалистов из различных областей — от юристов и врачей до сценаристов и актёров. По данным The Verge, спрос на такие услуги за последний год вырос в несколько раз, а Handshake AI достигла оборота $150 млн в ноябре 2025 года.

Некоторые актёры выражают опасения, что их участие в подобных проектах может ускорить автоматизацию и привести к сокращению рабочих мест в творческих и интеллектуальных профессиях. Тем не менее, компании продолжают наращивать объёмы данных, чтобы повысить способность ИИ к распознаванию и воспроизведению сложных аспектов человеческого общения.

Команда инженеров из лаборатории StorageReview установила новый мировой рекорд по вычислению числа Пи, достигнув 314 триллионов знаков после запятой. Все вычисления были выполнены на одном сервере Dell PowerEdge R7725, который работал непрерывно 110 дней без единого сбоя или перезагрузки.

Система была оснащена двумя процессорами AMD EPYC, 1,5 терабайтами оперативной памяти и 40 NVMe SSD-накопителями, из которых 34 использовались для вычислений. Для расчётов применялось специализированное ПО y-cruncher, способное эффективно обрабатывать огромные объёмы данных и выполнять сложные численные операции с высокой точностью.

Главной сложностью при вычислении столь большого количества знаков стала не математика, а обработка и перемещение гигантских объёмов промежуточных данных. Для этого NVMe-накопители были напрямую подключены к процессорам по высокоскоростным линиям PCIe, что обеспечило пропускную способность до 280 ГБ/с и позволило избежать узких мест в системе хранения.

В ходе вычислений сервер потреблял в среднем 1600 Вт, а общее энергопотребление составило 4305 кВт·ч — это значительно эффективнее по сравнению с предыдущими рекордами, где использовались более крупные и энергоёмкие кластеры. Новый результат был достигнут не за счёт увеличения числа узлов, а благодаря оптимизации архитектуры и эффективному использованию ресурсов.

Подобные вычисления служат не только математическим рекордом, но и тестируют надёжность современных вычислительных систем, выявляя слабые места в оборудовании и ПО. Технологии, разработанные для таких задач, находят применение в научных симуляциях, анализе больших данных и инфраструктуре искусственного интеллекта.

Космические томаты: экипаж «Шэньчжоу-21» собрал первый урожай на орбитальной станции «Тяньгун»

Экипаж пилотируемой миссии «Шэньчжоу-21», находящийся на борту китайской орбитальной станции «Тяньгун», сообщил о первом успешном урожае «космических томатов». По данным China Central Television (CCTV), астронавты вырастили томаты-черри с использованием аэропонной установки, сфотографировали и отобрали зрелые плоды, а затем герметично упаковали растения и урожай для дальнейших исследований.

В ближайшее время экипаж планирует провести аналогичные эксперименты с пшеницей, морковью и лекарственными растениями. Цель — проверить ключевые технологии и расширить ассортимент культур, пригодных для выращивания в условиях микрогравитации, а также повысить эффективность биорегенеративных систем жизнеобеспечения для будущих длительных космических миссий.

Аэропонная система, разработанная специалистами Китайского центра подготовки и обучения астронавтов, работает по принципу распыления воды в виде мелкодисперсного тумана. Такой подход позволяет значительно повысить эффективность использования воды и создать оптимальные условия для роста растений в космосе.

Помимо агробиологических экспериментов, экипаж «Шэньчжоу-21» выполняет задачи по физике материалов, обслуживает оборудование регенеративной системы жизнеобеспечения, а также регулярно контролирует микробиологическую обстановку на станции. Астронавты проходят тренировки по медицинской эвакуации и проводят анализы крови для мониторинга состояния здоровья.

Миссия «Шэньчжоу-21» стартовала с космодрома Цзюцюань 31 октября 2025 года. Первый выход в открытый космос экипаж совершил 9 декабря. Полученные данные и опыт позволят совершенствовать технологии автономного жизнеобеспечения и выращивания пищи для будущих экспедиций.

Группа бывших сотрудников Anthropic объявила о запуске стартапа Mirendil, который будет разрабатывать искусственный интеллект для решения задач в области биологии и материаловедения. Основатели — Бехнам Нейшабур и Харш Мехта — покинули Anthropic в декабре 2025 года. Сейчас команда ведёт переговоры о привлечении $175 млн инвестиций при оценке компании в $1 млрд.

Бехнам Нейшабур ранее возглавлял команду по научному направлению в Anthropic, а до этого более пяти лет работал в Google DeepMind. Харш Мехта был старшим научным сотрудником Anthropic. В команду Mirendil также вошли Шаян Салехиан (экс-xAI) и Тара Резаеи (стажёр OpenAI).

Mirendil относится к новой волне «нео-лабораторий» — специализированных стартапов, которые создаются исследователями, покинувшими ведущие компании сектора. Такие компании фокусируются на узких задачах, например, автоматизации офисной работы или поиске новых подходов к обучению ИИ, чтобы преодолеть ограничения современных систем.

Mirendil планирует использовать искусственный интеллект для ускорения научных открытий, в первую очередь в биологии и материаловедении. Стартап намерен разрабатывать инструменты, которые помогут учёным анализировать большие объёмы данных, моделировать сложные процессы и находить новые закономерности, недоступные традиционным методам.

Компания MSI наконец-то решила проблему, которая порой проявляется на её системных платах и заключается в снижении пропускной способности линии PCIe и, как следствие, снижении производительности видеокарты.

О проблемах пользователи начали сообщать ещё в прошлом году. Но они проявлялись не так часто, так что MSI потребовалось немало времени, чтобы найти первопричину.

Технически MSI её не описывает, но говорит, что это довольно редкое сочетание модели системной платы, модели CPU, модели видеокарты, версии BIOS и AGESA. Важно отметить, что, во-первых, чаще всего проблема проявлялась на платах AM5, а во-вторых, порой люди жалуются на то же самое и с платами других производителей, но чаще именно с MSI.

Компания уже выпустила обновление, которое должно решить проблему, но пока почему-то только для платы MAG X870 Tomahawk WiFi. Вскоре обновление должно появиться и для других моделей.

У компании AMD есть уникальный для рынка x86 продукт: ПК с Ryzen AI Max, подходящие для запуска локального ИИ из-за большого объёма памяти. Теперь AMD решила рассказать, как локально запускать на таких системах набравший популярность OpenClaw. Это тот самый ИИ, для которого массово покупают Mac mini.

AMD опубликовала новое руководство по OpenClaw, основанное на двух вариантах аппаратного обеспечения для запуска локальных агентов ИИ под управлением Windows: RyzenClaw и RadeonClaw.

Как можно догадаться из названий, суть тут в том, на что будет упор: на CPU или GPU. Первый вариант — это как раз система на базе Ryzen AI Max+ со 128 ГБ унифицированной памяти. Обычный ПК не может предложить такое решение, так как у обычного ПК оперативная память является только оперативной, а в случае Ryzen AI Max (как и в случае платформ Apple M), это ещё и память GPU.

Второй второй подразумевает запуск на основе профессиональной карты Radeon AI PRO R9700, которая сама по себе предлагает 32 ГБ памяти.

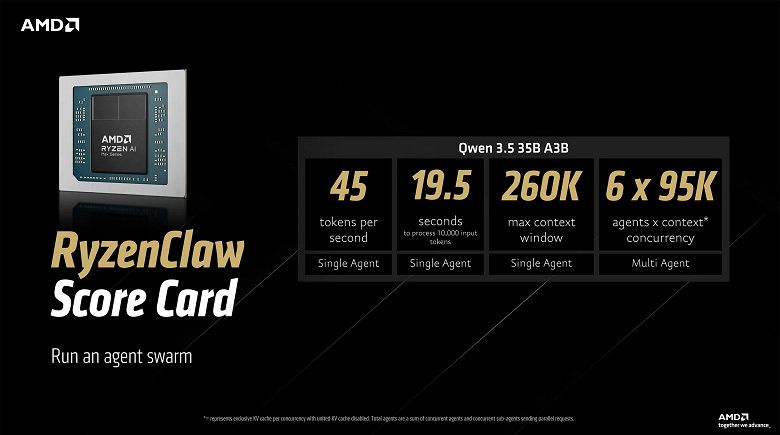

В случае с RyzenClaw нужно иметь не просто ПК с Ryzen AI Max, а именно версию со 128 ГБ оперативной памяти, потому как 96 ГБ будут зарезервированы для нужд GPU. Эта конфигурация работает на Qwen 3.5 35B A3B со скоростью около 45 токенов в секунду, поддерживает контекстное окно в 260 000 токенов и может обрабатывать до шести агентов одновременно.

RadeonClaw, конечно, мощнее, поэтому эта конфигурация обрабатывает примерно 120 токенов в секунду с той же моделью и обрабатывает 10 000 входных токенов примерно за 4,4 секунды. Впрочем, она поддерживает меньшее количество одновременно работающих агентов.

Подписаться